5千円台で買えるAndroidテレビ端末「Lovicool TX3 mini」からAmazon AWS上のElastic GPU付きの仮想Windowsに接続して、3DCGソフト「スケッチアップ」を使って「LuxRender」プラグインでフィルムカメラ シミュレーション(被写界深度やフィルムの選択など)を紹介します。

背景

最近、若い女性にフィルムカメラが人気らしいです。

オリンパスペンFの世界

私の場合は、40年ほど前に同僚から譲ってもらった「オリンパスペンF」というハーフサイズの一眼レフカメラが気に入ってしまい、デジカメに買い替えるまで15年くらいフィルムカメラを楽しんでいました。

今ではオリンパスペンもデジカメですが、最新機種の「E-PL9」より「E-PL6」の中古がオススメです。

YouTuberなどが自撮りをする時には三脚に取り付けて撮影すると思います。E-PL6は液晶モニターが上側に跳ね上がるので三脚に取り付けた状態でも観れます。E-PL9は下側なので観れませんね。

さらに、E-PL6は接写が可能な「魚眼コンバーター」も取り付けられるので、カメラに楽に手が届きます。中古なら2万円台前半(ホワイト)でAmazonで購入が可能です。

OLYMPUS E-PL9を買う前に!私がE-PL6を買った理由とは? >>> YouTubeサイトへ

フィルムカメラ シミュレーションを3DCGソフトでやってみる

フィルムカメラの場合は、デジカメやスマホと違って、フィルムの現像とプリントが済むまでは写真が見れないので、結果を確認するまでに時間がかかります。

テスト的に露出や被写界深度やフィルムの違いなどをパソコンの3DCGソフトでシミュレーション出来ると便利なのではないか?と考えました。

今回は、手軽に使えるAndroid TV端末でAmazonの仮想Windowsに接続して3DCGソフトの「スケッチアップ」を使って「LuxRender」プラグインでレンダリングして楽しむ方法を紹介します。

Android TV端末の使い方

私がAmazonで買ったAndroid TV端末「Lovicool TX3 mini」関連の記事は以下です。

Lovicool Android TV端末 関連の記事リストはこちら >>>

現在はさらにバージョンアップした製品がさらに安く出ているようなので確認してください。

Amazon Elastic GPU付き仮想Windowsの作り方と使い方

AmazonのElastic GPU付き仮想Windowsの作り方と使い方関連の記事は以下です。

Elastic GPU付き仮想Windows関連の記事リストはこちら >>>

Elastic GPUが使えるようになって、3DCGソフトがそのまま起動出来るようになり、手軽に3DCGが楽しめるようになりました。

ちなみに、Google Cloud Platform(GCP)でも無料でGPU付きの仮想Windowsが使えますが、OpenGLが古いので、3DCGソフトはほとんど起動できず使えません。

LuxRenderのスレーブは起動できるので、自宅のパソコン上やAWSの仮想Windows上で使う3DCGソフトで、LuxRenderのNetworkタブからGCPのスレーブに繋いで分散レンダリングに使っています。

ただし、LuxRenderはElastic GPUでは高速化が出来ないので、私の場合は、AWSのElastic GPU付きの仮想Windows上のLuxRenderのレンダリング速度は、自宅のMac miniの約半分です。

自宅にパソコンがある場合は、課金があるAWSを使うより自宅のパソコンを使った方が安くて速いと思います。

ただし、今回はGCPの16vCPUの仮想Windows上でLuxRenderスレーブを動かして分散レンダリングする事で、AWSだけの4倍以上の高速化を確認できました。

これは自宅のパソコンから分散レンダリングを行っても同様の効果が得られます。記事の最後の方で、分散レンダリングによる高速化について紹介しています。

Android TV端末からフィルムカメラ シミュレーションを動画で紹介

以下のYouTube動画で、TV端末のホーム画面からChromeを使ってAWSに接続して、スケッチアップでシーンを読み込んで、LuxRenderでレンダリングしながら「フィルムカメラ シミュレーション」の様子を紹介します。

Android TV端末から3DCGソフトでフィルムカメラシミュレーション >>> YouTubeサイトへ

レンダリング時間は1時間かかったので、動画の後でスクリーンショットを撮った画像を使って、以下で具体的なフィルムカメラ シミュレーションの設定と結果を紹介します。

フィルムカメラ シミュレーションの設定と結果

「Depth Of Field(DOF)」被写界深度をオンにすると、ピントが合う距離を設定してレンダリングすれば、前景と背景をボカすことが出来ます。

その他にも、例えば「富士フイルムのこのフィルム」とかの設定も出来るので、実際のフィルムカメラのような操作をしながら割と即座に結果を確認出来て便利です。

デフォールトの設定

・露出の設定:Auto Linear

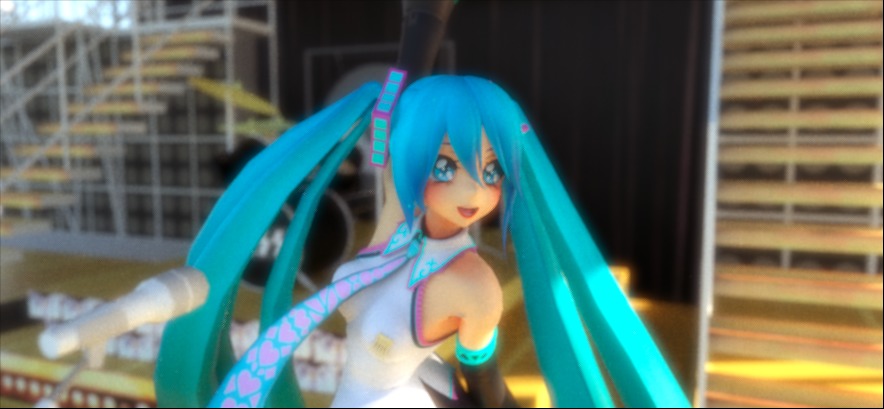

・その時の画像:

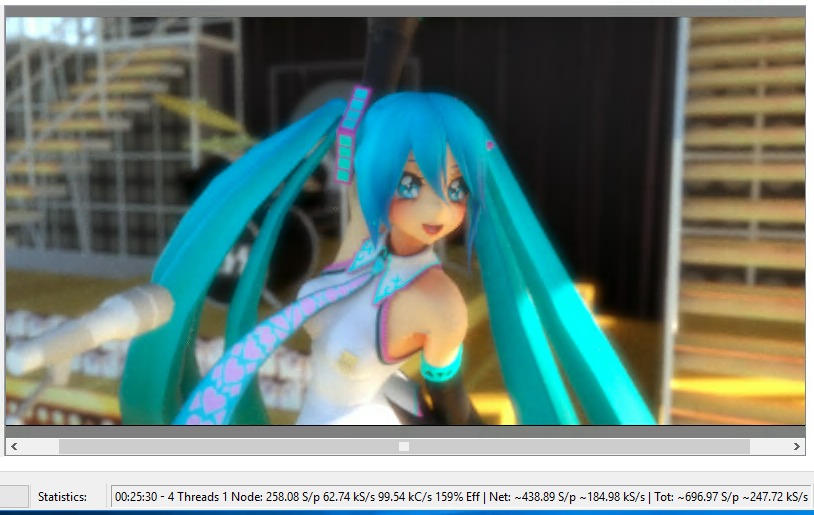

ピントは、初音ミクの右頰に合わせています。レンダリング開始から30分後くらいの画質です。手前のマイクとバックのステージがボケています。

露出をマニュアルで設定

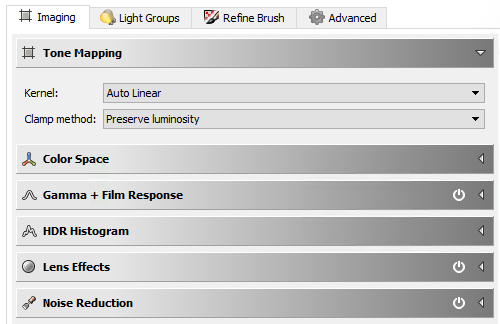

・露出の設定:Linear

・その時の画像:

同じような感じにします。ここでフィルム感度やシャッター速度や絞りやガンマを変えて、好みの露出にします。絞りは被写界深度と連動するので、ボカしたい場合は「2.8」などの小さい値にします。

フィルムのメーカーと種類を選択

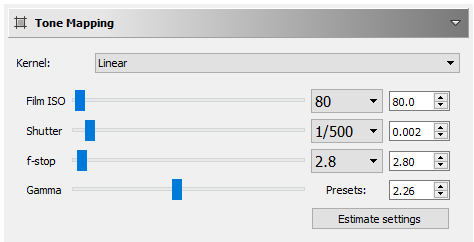

・フイルム:Fujifilm Cine F-250

・この時の画像:

富士フイルムのフィルムを使うと、若干赤っぽくなります。私の場合は、青っぽいより赤っぽい方が健康的な感じがするのでよく使います。

レンズ効果

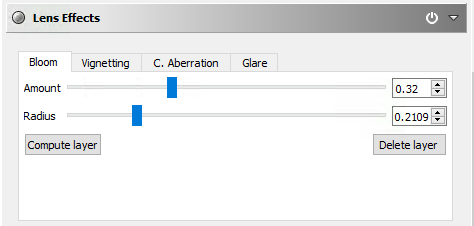

・レンズ効果:Bloom – Compute layerをクリック

・その時の画像:

若干ボケますが、フィルム写真のような柔らか味が出ます。

ノイズ軽減

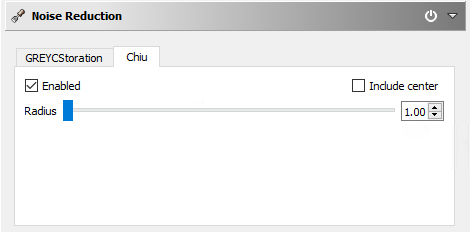

・ノイズ軽減:Chiu:Enable – Radius=1.00

・その時の画像:

ボカしフィルターを軽くかけて、レンダリング初期のノイズを軽減します。

それでも初期ノイズは残るので、1時間くらい(操作していると30分くらい経過するのでその残り時間)レンダリングするとノイズがかなり減ります。

1時間レンダリング後の最終画像

・1時間レンダリングしてストップ後にファイルに書き出したものです。

上記画像は、特にポストワークで画像編集や画像加工などは行なっていません。

分散レンダリングによる高速化

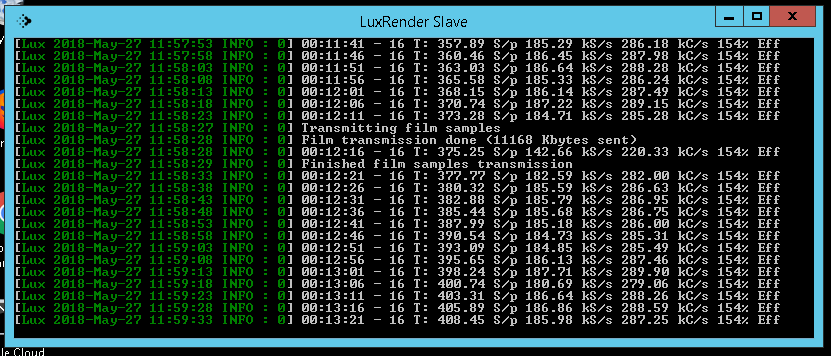

GCPに16vCPU(GPU無し)の仮想Windowsを作って、その上でLuxRenderスレーブを起動して、AWSの仮想WindowsのLuxRenderからネット接続して、分散レンダリングによる高速化を試みてみました。

最初は、スレーブ側で正常にレンダリングが出来ていないようでしたが、そのまま放置していたところ、分散レンダリングを開始して10分が過ぎた頃に正常に戻っている事が確認できました。

AWS側のLuxRenderの表示は以下です。

下側のステータス表示を見ると、AWS側が63kS/sに対し、GCP側のスレーブは185kS/sと約3倍になっており、合計で248kS/sと分散レンダリングにより約4倍の高速化が出来ました。

レンダリング画像を見て、25分の時点で前回の1時間の状態に達していると判断しストップ。書き出した画像が以下です。

前回は50%でレンダリングしていましたが、今回は100%に戻してレンダリングをしているので、実質的には4倍以上の性能が得られていると思います。

これにより、LuxRenderでもある程度高速にレンダリングが可能になったので、フィルムカメラ シミュレーションも実用的な段階になったと感じます。

色味が少し赤味が減ったのは、フィルムを富士フイルムの「Fujifilm Cine F-250」から「Fujifilm Cine F-125」に変更したためです。個人的にはF-250の方が好きですが・・・

まとめ

フィルムカメラと3DCGソフトは、以上のように関連性が深いのですが、3DCGはマニアックな趣味なので、カメラユーザーにとっては「知らない世界」なのではないか?と思います。

Androidテレビ端末は安価で使いやすいので、仮想Windowsに接続して3DCGソフトが手軽に使えるようになったことから、こういった使い方を試すのにちょうど良いような気がします。

まだ、仮想Windowsの使い勝手がマニアックなのでハードルは高いですが、慣れればそれほど難しい話ではないので、一度チャレンジしてみてはいかがでしょうか?

仮想Windowsは同じWindows環境を、パソコンからだけでなくタブレットやスマートフォンからも接続して使えるので、応用範囲は広いと思います。課金は発生しますが・・・

★Amazon Sumerianによるスケッチアップのシーンを無料でVR化する方法を紹介している記事などのリストは以下です。

ではでは、きらやん